Citrix SD-WANを使ってみる その3 (2020/05/06) [仮想化]

ドキュメントはこの辺から。

https://docs.citrix.com/en-us/citrix-sd-wan/11.html

https://docs.citrix.com/en-us/citrix-sd-wan-platforms

■6.Citrix SD-WANの設定変更・適用について

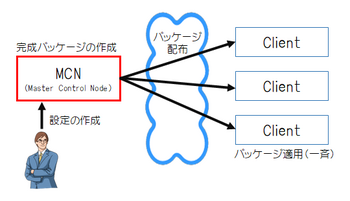

他のSD-WAN製品もそうかもしれませんが、一般のネットワーク機器とは少し設定概念が異なっています。一般的なネットワーク機器では設定は随時反映されますが、Citrix SD-WANでは完成形を作り、コンフィグパッケージを作成してからそのパケッケージに入れ替え、という流れになります。

設定の不備や不整合はコンフィグパッケージを作成する際のエラーチェックで弾かれますから、良くも悪くもCISCOルータのように手探りで少しずつ設定を投入するといったことができません。設定変更に伴う挙動の変化もリアルタイムではありませんから、チャレンジしようとする人にはハードルの高い製品と言えるかもしれません。

それを象徴するものとして、Citrix SD-WANでは、設定の作成・作り込み、配布は全てMCN(Master Control Node)と呼ばれる親機で行い、それ以外の機器はクライアントとして配布されたパケットを受け取るだけの存在になっています。クライアントは、管理系の一部の設定を除き、自身でコンフィグを変更をすることができません。

■7.コンフィグ作成実践編 ~ 拠点の作成

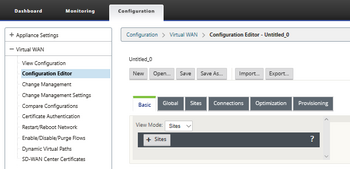

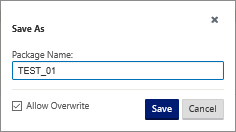

コンフィグ作成はConfiguration Editorから行います。参考となるひな形はないので、Newを押して下さい。Untitled_0が作成されます。分かりやすい名前を付けておきましょう。その際、Allow Overwriteオプションを付けておくと、上書き(更新保存)ができるので便利です。

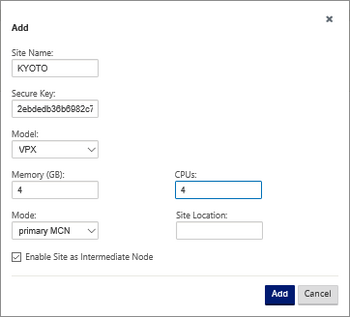

今回はCitrix Hypervisor版とVMware ESXi版を1つずつ用意したので、2拠点を作成することにします。拠点名は適当にKYOTOとNARAにします。Basicタブの中の、+Sitesを押し、以下のように設定します。NARAも同様に作成し、Modeをclientにします。

・Site Name:KYOTO

・Model:VPX

・Memory:4GB

・CPUs:2(もしくは4)

・Mode:primary MCN

Basicタブ配下の右半分の設定欄から細かい設定を行うことができますが、他のタブのサマリー設定的な位置付けなので、詳細は各タブ配下から行っていくことにします。

https://docs.citrix.com/en-us/citrix-sd-wan/11.html

https://docs.citrix.com/en-us/citrix-sd-wan-platforms

■6.Citrix SD-WANの設定変更・適用について

他のSD-WAN製品もそうかもしれませんが、一般のネットワーク機器とは少し設定概念が異なっています。一般的なネットワーク機器では設定は随時反映されますが、Citrix SD-WANでは完成形を作り、コンフィグパッケージを作成してからそのパケッケージに入れ替え、という流れになります。

設定の不備や不整合はコンフィグパッケージを作成する際のエラーチェックで弾かれますから、良くも悪くもCISCOルータのように手探りで少しずつ設定を投入するといったことができません。設定変更に伴う挙動の変化もリアルタイムではありませんから、チャレンジしようとする人にはハードルの高い製品と言えるかもしれません。

それを象徴するものとして、Citrix SD-WANでは、設定の作成・作り込み、配布は全てMCN(Master Control Node)と呼ばれる親機で行い、それ以外の機器はクライアントとして配布されたパケットを受け取るだけの存在になっています。クライアントは、管理系の一部の設定を除き、自身でコンフィグを変更をすることができません。

■7.コンフィグ作成実践編 ~ 拠点の作成

コンフィグ作成はConfiguration Editorから行います。参考となるひな形はないので、Newを押して下さい。Untitled_0が作成されます。分かりやすい名前を付けておきましょう。その際、Allow Overwriteオプションを付けておくと、上書き(更新保存)ができるので便利です。

今回はCitrix Hypervisor版とVMware ESXi版を1つずつ用意したので、2拠点を作成することにします。拠点名は適当にKYOTOとNARAにします。Basicタブの中の、+Sitesを押し、以下のように設定します。NARAも同様に作成し、Modeをclientにします。

・Site Name:KYOTO

・Model:VPX

・Memory:4GB

・CPUs:2(もしくは4)

・Mode:primary MCN

Basicタブ配下の右半分の設定欄から細かい設定を行うことができますが、他のタブのサマリー設定的な位置付けなので、詳細は各タブ配下から行っていくことにします。

Citrix SD-WANを使ってみる その2 (2020/05/05) [仮想化]

ドキュメントはこの辺から。

https://docs.citrix.com/en-us/citrix-sd-wan/11.html

https://docs.citrix.com/en-us/citrix-sd-wan-platforms

■4.初回起動・ログイン

起動させ、ログイン情報 admin/password(パスワードの文字列がpassword)でログインします。マネージメントポートはDHCP取得設定のため、IPアドレスが判明している場合は最初からWebブラウザでアクセスすることもできます。なお、初回ログイン時にパスワードの変更を要求されます。

IPアドレスが分からない場合は上記でコンソールログインすれば表示されます。DHCP環境でなければ、management_ipコマンドで手動設定することもできます。

■5.初期設定

運用周りの初期設定を行います。以下のようにConfigurationタブのAppliance SettingsとSystem Maintenanceの中で設定変更ができます。

・マネージメントポートのIPアドレス(Appliance Settings)

・Web GUIのタイムアウト時間(Appliance Settings)

・タイムゾーン(System Maintenance)

https://docs.citrix.com/en-us/citrix-sd-wan/11.html

https://docs.citrix.com/en-us/citrix-sd-wan-platforms

■4.初回起動・ログイン

起動させ、ログイン情報 admin/password(パスワードの文字列がpassword)でログインします。マネージメントポートはDHCP取得設定のため、IPアドレスが判明している場合は最初からWebブラウザでアクセスすることもできます。なお、初回ログイン時にパスワードの変更を要求されます。

IPアドレスが分からない場合は上記でコンソールログインすれば表示されます。DHCP環境でなければ、management_ipコマンドで手動設定することもできます。

■5.初期設定

運用周りの初期設定を行います。以下のようにConfigurationタブのAppliance SettingsとSystem Maintenanceの中で設定変更ができます。

・マネージメントポートのIPアドレス(Appliance Settings)

・Web GUIのタイムアウト時間(Appliance Settings)

・タイムゾーン(System Maintenance)

Citrix SD-WANを使ってみる その1 (2020/05/02) [仮想化]

Citrix SD-WANがトライアルでいろいろと試せるようなので、少し使ってみることにします。今回は仮想アプライアンス版を使ってみます。なお、私はCitrix社のエンジニアではないので、不正確なことや間違ったことを言っている可能性もあります。その辺りは私の書いたことを鵜呑みにせず、自己責任でお願いします。

ドキュメントはこの辺から。

https://docs.citrix.com/en-us/citrix-sd-wan/11.html

https://docs.citrix.com/en-us/citrix-sd-wan-platforms

■1.基本的な概念

Citrix SD-WANとして、大きく3つのラインアップがあります。

・SD-WAN(仮想WAN)

・WAN高速化装置

・上記両方の機能を有したハイエンド版

上から順に、製品名として以下が対応します。

・Citrix SD-WAN Standard Edition (Virtual WAN/SE)

・Citrix SD-WAN Optimization Edition (WANOP)

・Citrix SD-WAN Premium (PE)

今回試そうとしているのは、Standard Editionです。

■1.仮想イメージの入手

評価版のダウンロードにはCitrixのアカウントが必要なため、新規登録するなり、会社の担当者にユーザ追加してもらうなりしてください。アカウントでログインするとダウンロードできるようになります。

SD-WAN Standard Edition VPX for XenServer, ESXi, Hyper-V, KVM Software階層のVirtual Appliance(下の方)にいろいろとそろっているので、自分の必要とするイメージをダウンロードします。今回は以下の2つを使うことにします。

・SD-WAN Standard Edition VPX base image for Citrix XenServer(.xva)

・SD-WAN Standard Edition VPX base image for VMWare ESXi(.ova)

■2.システム要件

ドキュメントによるとシステム要件は以下の通りです。仮想イメージのハードウェア構成も以下がベースとなっています。なお、CPUパワーをかなり必要とします。動作させるだけであれば、Intel J4105(Celeronに毛が生えたぐらい)で作った仮想基盤でも動かすことはできました。

・論理CPU:4

・メモリ:4GB

・ストレード:40GB

・ネットワークインタフェース:1

■3.インストール

.xvaや.ovaの展開は各自実施して下さい。ネットワークインタフェースの1つは、マネージメントポート(管理ポート)に割当てられるため、SD-WANに使うインタフェースを追加で割り当てます。LANとWAN向けに最低2つを追加します。タグVLANにも対応しているため、ネットワークの知識がある場合は、1つだけの追加でも良いです。

ドキュメントはこの辺から。

https://docs.citrix.com/en-us/citrix-sd-wan/11.html

https://docs.citrix.com/en-us/citrix-sd-wan-platforms

■1.基本的な概念

Citrix SD-WANとして、大きく3つのラインアップがあります。

・SD-WAN(仮想WAN)

・WAN高速化装置

・上記両方の機能を有したハイエンド版

上から順に、製品名として以下が対応します。

・Citrix SD-WAN Standard Edition (Virtual WAN/SE)

・Citrix SD-WAN Optimization Edition (WANOP)

・Citrix SD-WAN Premium (PE)

今回試そうとしているのは、Standard Editionです。

■1.仮想イメージの入手

評価版のダウンロードにはCitrixのアカウントが必要なため、新規登録するなり、会社の担当者にユーザ追加してもらうなりしてください。アカウントでログインするとダウンロードできるようになります。

SD-WAN Standard Edition VPX for XenServer, ESXi, Hyper-V, KVM Software階層のVirtual Appliance(下の方)にいろいろとそろっているので、自分の必要とするイメージをダウンロードします。今回は以下の2つを使うことにします。

・SD-WAN Standard Edition VPX base image for Citrix XenServer(.xva)

・SD-WAN Standard Edition VPX base image for VMWare ESXi(.ova)

■2.システム要件

ドキュメントによるとシステム要件は以下の通りです。仮想イメージのハードウェア構成も以下がベースとなっています。なお、CPUパワーをかなり必要とします。動作させるだけであれば、Intel J4105(Celeronに毛が生えたぐらい)で作った仮想基盤でも動かすことはできました。

・論理CPU:4

・メモリ:4GB

・ストレード:40GB

・ネットワークインタフェース:1

■3.インストール

.xvaや.ovaの展開は各自実施して下さい。ネットワークインタフェースの1つは、マネージメントポート(管理ポート)に割当てられるため、SD-WANに使うインタフェースを追加で割り当てます。LANとWAN向けに最低2つを追加します。タグVLANにも対応しているため、ネットワークの知識がある場合は、1つだけの追加でも良いです。

VMware Workstation Player(VMware Player)でVLANタグを使う その2 (2020/04/26) [仮想化]

でまあ、私もVMware Playerは実質ESTモードオンリー諦めていたのですが、いろいろ試行錯誤したらVGTモードが成功したので紹介します。肝となる部分は、おそらくネットワークチップだと思います。

成功したのは、USBネットワークインタフェースであり、「I-O DATA ETG5-US3」です。搭載しているチップはASIX AX88179です。同じチップを使用している場合は、成功するかもしれません。

まずドライバは最新に更新しておきましょう。2020年4月26日現在、Windows10上からアップデートの自動検索をすればチップメーカーの最新である「1.20.6.0」に更新されます。

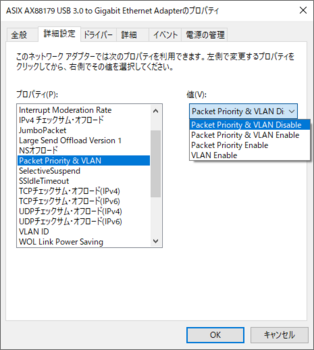

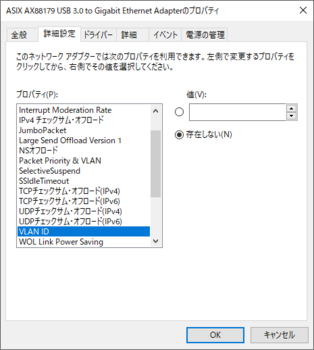

設定のポイントは2つ。以下のように、「VLAN Disable」にすることと、「VLAN IDなし」にすることです。VLAN Disableにしておけば、後者の設定の設定は無視されるような気もします。これはネットワークインタフェースカードでVLANの解釈をしない設定となるため、タグVLAN付きのパケットをキャプチャする際にも有用となります。

当然、VMware Player側では、該当インタフェースは「ブリッジ:物理インタフェースに接続」を選んでおく必要があります。また、チップが異なっても同等の設定を行うことで、うまくいく可能性もあります。

仮想マシンでVLANタグを付けたインタフェースと、CISCOルータのTrunk VLANポートでping疎通ができたので成功しているものと思われます。

成功したのは、USBネットワークインタフェースであり、「I-O DATA ETG5-US3」です。搭載しているチップはASIX AX88179です。同じチップを使用している場合は、成功するかもしれません。

まずドライバは最新に更新しておきましょう。2020年4月26日現在、Windows10上からアップデートの自動検索をすればチップメーカーの最新である「1.20.6.0」に更新されます。

設定のポイントは2つ。以下のように、「VLAN Disable」にすることと、「VLAN IDなし」にすることです。VLAN Disableにしておけば、後者の設定の設定は無視されるような気もします。これはネットワークインタフェースカードでVLANの解釈をしない設定となるため、タグVLAN付きのパケットをキャプチャする際にも有用となります。

当然、VMware Player側では、該当インタフェースは「ブリッジ:物理インタフェースに接続」を選んでおく必要があります。また、チップが異なっても同等の設定を行うことで、うまくいく可能性もあります。

仮想マシンでVLANタグを付けたインタフェースと、CISCOルータのTrunk VLANポートでping疎通ができたので成功しているものと思われます。

タグ:VMWare

VMware Workstation Player(VMware Player)でVLANタグを使う その1 (2020/04/26) [仮想化]

VMware Playerはパソコン(Windows)の中に仮想環境が作ることができる便利なソフトウェアです。個人利用、および商用以外での利用の場合は無償で使用することができます。

とまあ、簡易的に試すには便利なソフトウェアなのですが、簡易版だけあっていろいろと機能制限があったりします。特に困るのはVLAN(vSwitch)関係です。基本的にサーバ系OSのお試しインストールを行うようなケースでは問題になりませんが、複数のネットワークインタフェースカードを使用する構成では、問題が顕在化します。

まあ、私はVLAN(VLANタグ)は最初から扱えないものだと思って割り切って使っていましたが、そうではないようです。

とりあえずVMWareにおけるVLAN(タギング)の扱いが分かりにくいので、ESXiの仮想スイッチ(vSwitch)の概念でおさらいします。vSwitchの動作モードには何パターンかあり、以下の図で言う②と③の状態が変わるということです。

■VGT(Virtual Guest Tagging)

・①仮想マシン側でVLANタギングを行う

・②③はVLANタグに対して何もせずスルーする

・④Catalystスイッチなどで、Trunk VLANの設定で収容

■EST(External Switch Tagging)

・①VLANタギングなし

・②③VLANタギングなし

・④Catalystスイッチなどで、Access VLANの設定で収容(ポートVLAN)

■VST(Virtual Switch Tagging)

・①VLANタギングなし

・②VLANタギングなし

・③vSwitchの設定で、②に対応するVLANタグを付与

・④Catalystスイッチなどで、Trunk VLANの設定で収容

vSwitch自体がESXiの概念のため、VMware Playerでは登場しませんし設定変更もできません。ESTモードでの接続となっています。

なお、VMware Playerのネットワークインタフェースの設定に、ホストコンピュータの物理インタフェースにブリッジ接続するとか、NAT接続するといった設定項目がありますが、これはESTモードの中でどのように接続するかといった設定であり、上記の概念とは無関係です。

技術的に言えば、前者のVGT、EST、VSTは物理層(Layer1)~データリンク層(Layer2)に関する概念であり、後者はデータリンク層(Layer2)~ネットワーク層(Layer3)にかけての設定となります。Layer2として重複している部分があるので、分かりにくいところがあるかもしれません。

少なくともVMware PlayerにはvSwitchの設定概念がないため、ESTモードでしか接続できないと思っていましたし、世間もそういう認識のようでした。

ただ、一部のネットワークチップに限り、VGTの動作報告もあるようでした。(IntelとBroadcom) とは言ってもレジストリをいじる必要があり、かなりハードルは高いと思われます。

とまあ、簡易的に試すには便利なソフトウェアなのですが、簡易版だけあっていろいろと機能制限があったりします。特に困るのはVLAN(vSwitch)関係です。基本的にサーバ系OSのお試しインストールを行うようなケースでは問題になりませんが、複数のネットワークインタフェースカードを使用する構成では、問題が顕在化します。

まあ、私はVLAN(VLANタグ)は最初から扱えないものだと思って割り切って使っていましたが、そうではないようです。

とりあえずVMWareにおけるVLAN(タギング)の扱いが分かりにくいので、ESXiの仮想スイッチ(vSwitch)の概念でおさらいします。vSwitchの動作モードには何パターンかあり、以下の図で言う②と③の状態が変わるということです。

■VGT(Virtual Guest Tagging)

・①仮想マシン側でVLANタギングを行う

・②③はVLANタグに対して何もせずスルーする

・④Catalystスイッチなどで、Trunk VLANの設定で収容

■EST(External Switch Tagging)

・①VLANタギングなし

・②③VLANタギングなし

・④Catalystスイッチなどで、Access VLANの設定で収容(ポートVLAN)

■VST(Virtual Switch Tagging)

・①VLANタギングなし

・②VLANタギングなし

・③vSwitchの設定で、②に対応するVLANタグを付与

・④Catalystスイッチなどで、Trunk VLANの設定で収容

vSwitch自体がESXiの概念のため、VMware Playerでは登場しませんし設定変更もできません。ESTモードでの接続となっています。

なお、VMware Playerのネットワークインタフェースの設定に、ホストコンピュータの物理インタフェースにブリッジ接続するとか、NAT接続するといった設定項目がありますが、これはESTモードの中でどのように接続するかといった設定であり、上記の概念とは無関係です。

技術的に言えば、前者のVGT、EST、VSTは物理層(Layer1)~データリンク層(Layer2)に関する概念であり、後者はデータリンク層(Layer2)~ネットワーク層(Layer3)にかけての設定となります。Layer2として重複している部分があるので、分かりにくいところがあるかもしれません。

少なくともVMware PlayerにはvSwitchの設定概念がないため、ESTモードでしか接続できないと思っていましたし、世間もそういう認識のようでした。

ただ、一部のネットワークチップに限り、VGTの動作報告もあるようでした。(IntelとBroadcom) とは言ってもレジストリをいじる必要があり、かなりハードルは高いと思われます。

タグ:VMWare

Citrix Hypervisor(XenServer)でSMB ISOライブラリを使うには(Citrix Hypervisor 8.0、2019/09/08) [仮想化]

Citrix Hypervisorに再びOpenBSDをインストールしようとしたのですが、普段はサーバの箱だけで運用しているので、USB接続とは言え実DVD-ROMドライブを接続するのがなんとも面倒くさい。

一応、Citrix HypervisorからSMBでISOイメージをマウントできるのですが、何回やっても失敗する。と思ってログを調べてみたら、

なるほど、そういうことですね。Citrix Hypervisorからはsmb2でネゴシエーションしてきているみたい。うちはSamba設定のmin protocolでsmb3を指定していたのですが、SMB2_02に修正してあげて解決しました。

一応、Citrix HypervisorからSMBでISOイメージをマウントできるのですが、何回やっても失敗する。と思ってログを調べてみたら、

[2019/09/08 21:18:14.428719, 3] ../source3/smbd/smb2_negprot.c:294(smbd_smb2_request_process_negprot) Selected protocol SMB3_00

なるほど、そういうことですね。Citrix Hypervisorからはsmb2でネゴシエーションしてきているみたい。うちはSamba設定のmin protocolでsmb3を指定していたのですが、SMB2_02に修正してあげて解決しました。

Sambaサーバの性能が出ない その9 (2019/07/31) [仮想化]

もののついでに、Citrix Hypervisor 8.0+メモリ12GBの環境でピーク性能を測ってみました。FreeBSD上にdd if=/dev/zeroで100GiBの単一ファイルを作り、同様にFastCopyでコピーしてみました。

転送速度は、半分の50GiB分の転送が終わった時点の数値を読み取っています。あと、試行を切り替える際は、キャッシュを読み込む可能性を排除するためにFreeBSD再起動とファイル名変更を行っています。

■Citrix Hypervisor 8.0

・FreeBSD 12.0R メモリ12GB gmirror(Mirror)

FastCopy FreeBSD→Win 74.5MiB/s

・FreeBSD 12.0R メモリ12GB gmirror(Mirror)

FastCopy Win→FreeBSD 84.4MiB/s

こうやってみると、Citrix Hypervisorはなかなか優秀なようですね。

転送速度は、半分の50GiB分の転送が終わった時点の数値を読み取っています。あと、試行を切り替える際は、キャッシュを読み込む可能性を排除するためにFreeBSD再起動とファイル名変更を行っています。

■Citrix Hypervisor 8.0

・FreeBSD 12.0R メモリ12GB gmirror(Mirror)

FastCopy FreeBSD→Win 74.5MiB/s

・FreeBSD 12.0R メモリ12GB gmirror(Mirror)

FastCopy Win→FreeBSD 84.4MiB/s

こうやってみると、Citrix Hypervisorはなかなか優秀なようですね。

Sambaサーバの性能が出ない その8 (2019/07/31) [仮想化]

さてさて、こちらはCitrix Hypervisor 8.0の数字です。

■Citrix Hypervisor 8.0

・FreeBSD 12.0R メモリ2GB gmirror(Mirror)

FastCopy Win→FreeBSD 55.2MiB/s

・FreeBSD 12.0R メモリ12GB gmirror(Mirror)

FastCopy Win→FreeBSD 67.4MiB/s

・FreeBSD 12.0R メモリ2GB gmirror(Single、片系)

FastCopy Win→FreeBSD 56.5MiB/s

・FreeBSD 12.0R メモリ7GB gmirror(Single、片系)

FastCopy Win→FreeBSD 57.0MiB/s

・FreeBSD 12.0R メモリ12GB gmirror(Single、片系)

FastCopy Win→FreeBSD 67.3MiB/s

・FreeBSD 12.0R メモリ2GB No gmirror(Native)

FastCopy Win→FreeBSD 56.8MiB/s

・FreeBSD 12.0R メモリ12GB No gmirror(Native)

FastCopy Win→FreeBSD 67.2MiB/s

といった結果になりました。これはとても面白いですね。

vSphereと違って、gmirrorを使っても性能は変わらないことが分かります。これは準仮想化を実装するドライバの作りやレイヤが関係しているのでしょうか。また、FreeBSDにメモリを多く(12GB)割り当てると、多少ですが性能が向上するようです。

これらの数字を見る限り、FreeBSDを使いたくて、かつディスクI/Oに負荷が見込まれる場合は、Citrix Hypervisor を使った方が良さそうということが分かりました。VMWareに圧され、Xenの系譜は先がないと思っていたのですが、まだまだ充分に活躍できそうですね。

なお、前回のvSphereもそうですが、転送速度は上記は大きなファイル、小さなファイルが多種多様に混合されたものをFastCopyで転送しています。記録は総転送量÷総時間で算出されているようなので、転送速度はマイルド寄りになっていると思われます。

■Citrix Hypervisor 8.0

・FreeBSD 12.0R メモリ2GB gmirror(Mirror)

FastCopy Win→FreeBSD 55.2MiB/s

・FreeBSD 12.0R メモリ12GB gmirror(Mirror)

FastCopy Win→FreeBSD 67.4MiB/s

・FreeBSD 12.0R メモリ2GB gmirror(Single、片系)

FastCopy Win→FreeBSD 56.5MiB/s

・FreeBSD 12.0R メモリ7GB gmirror(Single、片系)

FastCopy Win→FreeBSD 57.0MiB/s

・FreeBSD 12.0R メモリ12GB gmirror(Single、片系)

FastCopy Win→FreeBSD 67.3MiB/s

・FreeBSD 12.0R メモリ2GB No gmirror(Native)

FastCopy Win→FreeBSD 56.8MiB/s

・FreeBSD 12.0R メモリ12GB No gmirror(Native)

FastCopy Win→FreeBSD 67.2MiB/s

といった結果になりました。これはとても面白いですね。

vSphereと違って、gmirrorを使っても性能は変わらないことが分かります。これは準仮想化を実装するドライバの作りやレイヤが関係しているのでしょうか。また、FreeBSDにメモリを多く(12GB)割り当てると、多少ですが性能が向上するようです。

これらの数字を見る限り、FreeBSDを使いたくて、かつディスクI/Oに負荷が見込まれる場合は、Citrix Hypervisor を使った方が良さそうということが分かりました。VMWareに圧され、Xenの系譜は先がないと思っていたのですが、まだまだ充分に活躍できそうですね。

なお、前回のvSphereもそうですが、転送速度は上記は大きなファイル、小さなファイルが多種多様に混合されたものをFastCopyで転送しています。記録は総転送量÷総時間で算出されているようなので、転送速度はマイルド寄りになっていると思われます。

Sambaサーバの性能が出ない その7 (2019/07/28) [仮想化]

vSphere 6.7でFreeBSD 12.0Rを本格運用しようとして、環境を崩す前の状態に戻そうとしています。待避していたSamba(NAS)の中身を書き戻していたところ、思うように性能が出ないことが分かりました。

さすがにこれはちょっと性能が出なさすぎですね…。前回までに取得した基礎データと数字が違いすぎます。

おそらく洗い出し切れていない隠された条件があると思われるので、いろいろとパターンを変えて試してみました。

■vSphere 6.7

・FreeBSD 12.0R メモリ2GB gmirror(Mirror)

FastCopy Win→FreeBSD 21.4MiB/s

・FreeBSD 12.0R メモリ2GB gmirror(Single、片系)

FastCopy Win→FreeBSD 20.9MiB/s

・FreeBSD 12.0R メモリ12GB gmirror(Single)

FastCopy Win→FreeBSD 21.0MiB/s

・FreeBSD 12.0R メモリ2GB No gmirror(Native)

FastCopy Win→FreeBSD 56.0MiB/s

最初はgmirrorのミラーリングによるI/Oの増加が原因ではないかと疑っていたのですが、ディスクを外してgmirror(Single、片系)にしても数字は変わりませんでした。メモリを増やしても変わらず。

最終的にgmirrorを外してネイティブ(/dev/da0)のディスクアクセスにしたら、劇的に性能が向上しました。ドライバ等の関係で、gmirror経由にすると準仮想化の恩恵が受けられないのかもしれません。

さすがにこれはちょっと性能が出なさすぎですね…。前回までに取得した基礎データと数字が違いすぎます。

おそらく洗い出し切れていない隠された条件があると思われるので、いろいろとパターンを変えて試してみました。

■vSphere 6.7

・FreeBSD 12.0R メモリ2GB gmirror(Mirror)

FastCopy Win→FreeBSD 21.4MiB/s

・FreeBSD 12.0R メモリ2GB gmirror(Single、片系)

FastCopy Win→FreeBSD 20.9MiB/s

・FreeBSD 12.0R メモリ12GB gmirror(Single)

FastCopy Win→FreeBSD 21.0MiB/s

・FreeBSD 12.0R メモリ2GB No gmirror(Native)

FastCopy Win→FreeBSD 56.0MiB/s

最初はgmirrorのミラーリングによるI/Oの増加が原因ではないかと疑っていたのですが、ディスクを外してgmirror(Single、片系)にしても数字は変わりませんでした。メモリを増やしても変わらず。

最終的にgmirrorを外してネイティブ(/dev/da0)のディスクアクセスにしたら、劇的に性能が向上しました。ドライバ等の関係で、gmirror経由にすると準仮想化の恩恵が受けられないのかもしれません。

SD-WANを考える その3 (2019/07/27) [仮想化]

Citrix SD-WANのトライアル、動きました!

初期パスワードは、admin/passwordでした。

マネージメントインタフェースのIPアドレスがDHCPになっているようなので、以下のコマンドで変更できます。

初期パスワードは、admin/passwordでした。

マネージメントインタフェースのIPアドレスがDHCPになっているようなので、以下のコマンドで変更できます。

>management_ip >set_management_ip set interface [ip] [subnetmask] [gateway] >apply

タグ:SD-WAN